Das KI-Verordnung Framework: In 4 Schritten zur Klarheit

- jimsigne

- 1. Apr.

- 8 Min. Lesezeit

180 Seiten. 113 Artikel. Dutzende Definitionen.

Wer zum ersten Mal die EU-Verordnung über künstliche Intelligenz — kurz KI-VO oder AI Act — öffnet, steht vor einer Herausforderung: Wo anfängt? Was ist relevant für mein Projekt? Und was muss ich eigentlich konkret tun?

Die gute Nachricht: Ihr müsst nicht alles lesen. Die KI-Verordnung folgt einer klaren Logik — einem Framework, das ihr in vier Schritten durchlaufen könnt. In diesem Artikel zeigen wir euch dieses Framework, erklären jede Stufe, und geben euch praktische Tipps, wo ihr am besten startet.

Der "umgekehrte" Ansatz: Erst Risiko, dann Definition

Bevor wir ins Framework einsteigen, ein wichtiger Tipp aus der Praxis:

Der clevere Einstieg: Prüft zuerst, ob euer System in eine der Risikokategorien fällt. Nur wenn die Antwort "ja" oder "vielleicht" ist, lohnt es sich, die genaue Definition von "KI-System" zu analysieren.Warum? Die Definition eines KI-Systems im AI Act ist nicht vollständig klar und erfordert erheblichen Aufwand. Diesen Aufwand könnt ihr vermeiden, wenn euer System ohnehin nicht in eine der regulierten Kategorien fällt.

Dieser Ansatz stammt aus einer Analyse des Knowledge Centre Data & Society und hat einen praktischen Vorteil: Er spart Zeit und fokussiert eure Energie auf das Wesentliche.

Das Framework: 4 Schritte zur Klarheit

Gehen wir jeden Schritt durch.

Schritt 1: Gilt die KI-Verordnung überhaupt?

Nicht jedes KI-System fällt unter die Verordnung. Es gibt explizite Ausnahmen:

Ausnahmen vom Anwendungsbereich

Forschung & Entwicklung:

KI-Systeme, die ausschließlich für wissenschaftliche Forschung und Entwicklung entwickelt und eingesetzt werden, sind ausgenommen (Art. 2 Abs. 6). Aber Achtung: Sobald ein System über die Forschung hinaus vermarktet oder genutzt wird, gelten alle Regeln.

Private, nicht-professionelle Nutzung:

Die KI-VO gilt nicht, wenn natürliche Personen ein System rein privat und nicht-professionell nutzen.

Nationale Sicherheit & Militär:

Systeme für Verteidigung, militärische Zwecke oder nationale Sicherheit sind ausgenommen.

Internationale Organisationen:

KI-Systeme, die von internationalen Organisationen oder Drittstaaten für Strafverfolgungskooperationen mit der EU genutzt werden, unter bestimmten Bedingungen.

Praxis-Tipp: "Wir sind noch in der Entwicklung" ist keine dauerhafte Ausrede. Praktisch ist es klug, die Anforderungen bereits in der Entwicklungsphase zu berücksichtigen — auch wenn sie formal noch nicht gelten.Schritt 2: Die Risiko-Klassifizierung

Das Herzstück der KI-Verordnung ist der risikobasierte Ansatz. Je höher das Risiko, desto strenger die Anforderungen. Es gibt vier Stufen:

Stufe 1: Verbotene Praktiken (Art. 5)

Diese Systeme dürfen in der EU nicht auf den Markt gebracht, in Betrieb genommen oder verwendet werden. Sie gelten als unvereinbar mit europäischen Grundwerten.

Was ist verboten?

Manipulative Systeme: Unterschwellige Techniken oder absichtlich manipulative/täuschende Methoden, die das Verhalten von Personen wesentlich beeinflussen und zu erheblichem Schaden führen können.

Ausnutzung von Vulnerabilitäten: Systeme, die Schwachstellen aufgrund von Alter, Behinderung oder sozialer/wirtschaftlicher Situation ausnutzen.

Social Scoring: Bewertung oder Klassifizierung von Personen basierend auf Sozialverhalten oder persönlichen Eigenschaften, die zu ungerechtfertigter Benachteiligung führt.

Biometrische Echtzeit-Identifikation: In öffentlich zugänglichen Räumen für Strafverfolgungszwecke (mit engen Ausnahmen).

Emotionserkennung am Arbeitsplatz/in Bildungseinrichtungen: Basierend auf biometrischen Daten (Ausnahme: medizinische oder Sicherheitszwecke).

Gesichtserkennungs-Datenbanken: Aufbau durch ungezieltes Scraping von Bildern aus dem Internet oder CCTV.

Kriminalitäts-Risikovorhersage: Basierend ausschließlich auf Profiling oder Persönlichkeitsmerkmalen.

Biometrische Kategorisierung: Nach sensiblen Merkmalen wie Rasse, politischer Meinung, religiöser Überzeugung, sexueller Orientierung.

Stufe 2: Hochrisiko-Systeme (Art. 6)

Diese Systeme können ernsthafte Risiken für Gesundheit, Sicherheit oder Grundrechte darstellen. Sie sind erlaubt, aber streng reguliert.

Es gibt zwei Typen von Hochrisiko-Systemen:

Typ 1 — Produktsicherheit:

KI-Systeme, die Teil eines Produkts sind (oder Sicherheitskomponente davon), das unter bestehende EU-Produktgesetzgebung fällt UND eine Konformitätsbewertung durch Dritte erfordert.

Beispiele: Medizinprodukte, Maschinen, Spielzeug, Aufzüge, Druckgeräte, Funkanlagen.

Typ 2 — Spezifische Anwendungsbereiche:

KI-Systeme für bestimmte Zwecke in bestimmten Kontexten:

Bereich | Beispiele |

|---|---|

Biometrie | Remote-Identifikation, Emotionserkennung, biometrische Kategorisierung |

Kritische Infrastruktur | Verkehrssteuerung, Wasser-/Gas-/Stromversorgung |

Bildung | Zugang zu Institutionen, Bewertung von Lernleistungen, Prüfungsüberwachung |

Beschäftigung | Recruiting, Beförderung, Kündigung, Aufgabenverteilung, Leistungsüberwachung |

Öffentliche Dienste | Sozialleistungen, Kreditwürdigkeit, Notrufe, Versicherungs-Risikobewertung |

Wichtige Ausnahme: Typ-2-Systeme gelten nicht als Hochrisiko, wenn sie kein erhebliches Risiko für Gesundheit, Sicherheit oder Grundrechte darstellen. Dies ist der Fall, wenn das System:

1. Eine enge prozedurale Aufgabe erfüllt

2. Das Ergebnis einer zuvor abgeschlossenen menschlichen Aktivität verbessert

3. Entscheidungsmuster erkennt, ohne menschliche Bewertungen zu ersetzen

4. Eine vorbereitende Aufgabe für eine Bewertung durchführt

Diese Ausnahme gilt nicht, wenn das System Profiling durchführt.Stufe 3: Transparenzpflichten (Art. 50)

Unabhängig von der Risikoeinstufung gelten für bestimmte Systeme zusätzliche Transparenzanforderungen:

Wenn... | Dann... |

KI interagiert direkt mit Personen (Chatbot) | Nutzer informieren, dass sie mit KI sprechen |

KI generiert synthetische Inhalte (Text, Bild, Audio, Video) | Maschinenlesbare Markierung |

Emotionserkennung oder biometrische Kategorisierung | Betroffene informieren |

Deepfakes oder KI-generierte Texte zu öffentlichen Themen | Offenlegungspflicht |

Details zu Artikel 50 findet ihr in unserem Artikel: "Artikel 50 EU AI Act: Transparenzpflichten einfach erklärt"

Stufe 4: Minimales Risiko

Alle anderen KI-Systeme — die große Mehrheit — unterliegen keinen spezifischen Anforderungen. Die Nutzung ist frei, aber freiwillige Verhaltenskodizes werden empfohlen.

Schritt 3: Welche Rolle habt ihr?

Die KI-Verordnung definiert verschiedene Akteure mit unterschiedlichen Pflichten. Eure Rolle bestimmt, welche Anforderungen für euch gelten.

Die wichtigsten Rollen

Provider (Anbieter):

Wer ein KI-System oder GPAI-Modell entwickelt (oder entwickeln lässt) UND es unter eigenem Namen/Marke auf den Markt bringt oder in Betrieb nimmt. Das ist die Rolle mit den meisten Pflichten.

Deployer (Betreiber):

Wer ein KI-System unter eigener Verantwortung nutzt — außer für rein private, nicht-professionelle Zwecke.

Importer (Importeur):

Wer ein KI-System aus einem Drittland in der EU auf den Markt bringt.

Distributor (Händler):

Wer ein KI-System auf dem Markt bereitstellt, aber weder Provider noch Importeur ist.

Third-Party Supplier (Drittanbieter):

Wer ein KI-System, Tool, Service oder Komponente bereitstellt, das in einem Hochrisiko-System verwendet oder integriert wird.

Manufacturer (Hersteller):

Nicht explizit im AI Act definiert. Aber: Wenn ein Hersteller ein KI-System als Sicherheitskomponente in ein Typ-1-Produkt integriert, kann er zum Provider werden.

Achtung — "Substantial Modification":

Wenn ein Importeur, Distributor, Deployer oder Drittanbieter eine wesentliche Änderung an einem bestehenden KI-System vornimmt, wird er zum Provider — mit allen entsprechenden Pflichten.

Eine wesentliche Änderung ist eine Änderung nach Inverkehrbringen, die nicht ursprünglich vorgesehen war und die Konformität oder den Verwendungszweck betrifft.Entscheidungsbaum: Welche Rolle seid ihr?

Frage 1: Entwickelt ihr das System selbst (oder lasst es entwickeln) und bringt es unter eurem Namen auf den Markt?

→ Ja: Ihr seid Provider

Frage 2: Nutzt ihr ein bestehendes System unter eigener Verantwortung?

→ Ja: Ihr seid Deployer

Frage 3: Importiert ihr ein System aus einem Nicht-EU-Land?

→ Ja: Ihr seid Importeur

Frage 4: Stellt ihr ein System auf dem Markt bereit (ohne es selbst zu nutzen)?

→ Ja: Ihr seid Distributor

Frage 5: Baut ihr Komponenten, die in Hochrisiko-Systeme integriert werden?

→ Ja: Ihr seid Third-Party Supplier

Hinweis: Es ist möglich, mehrere Rollen gleichzeitig zu haben — z.B. Provider UND Deployer, wenn ihr ein System entwickelt und selbst einsetzt.

Schritt 4: Welche Pflichten gelten für euch?

Die Pflichten hängen von zwei Faktoren ab: eurer Rolle und der Risikostufe eures Systems.

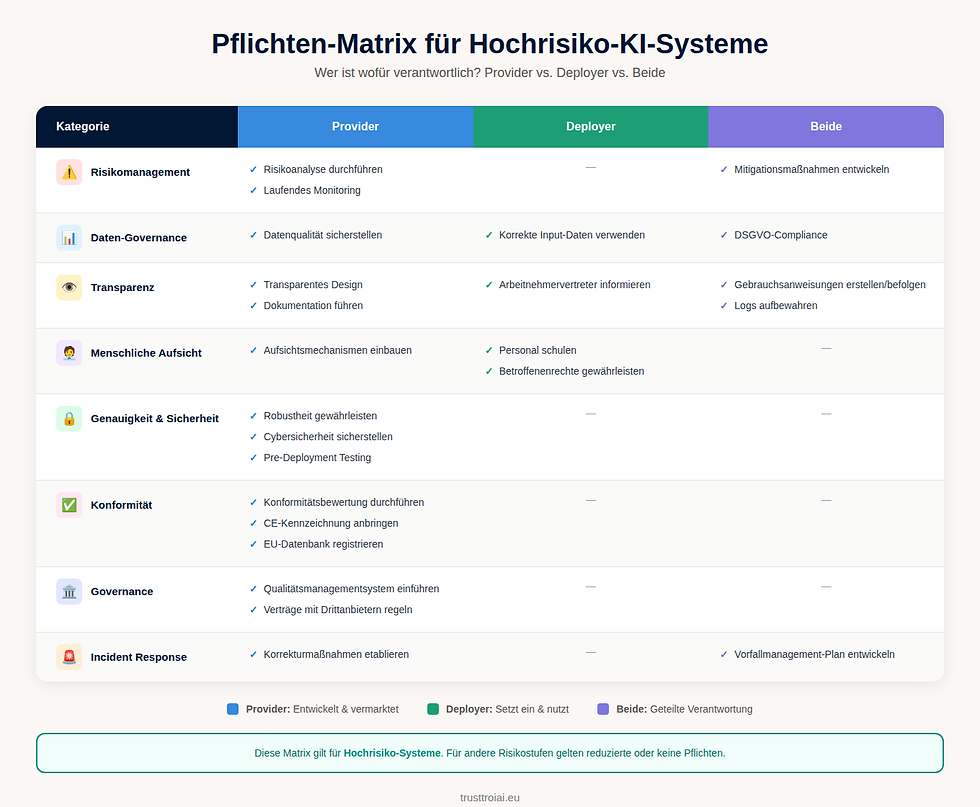

Pflichten-Übersicht für Hochrisiko-Systeme

Für Provider (P) und Deployer (D):

Kategorie | Pflichten |

Risikomanagement | Risikoanalyse durchführen (P), Mitigationsmaßnahmen entwickeln (P+D), laufendes Monitoring (P) |

Daten-Governance | Datenqualität sicherstellen (P), korrekte Input-Daten verwenden (D), DSGVO-Compliance (P+D) |

Transparenz | Transparentes Design (P), Gebrauchsanweisungen erstellen/befolgen (P+D), Dokumentation führen (P), Logs aufbewahren (P+D), Arbeitnehmervertreter informieren (D) |

Menschliche Aufsicht | Aufsichtsmechanismen einbauen (P), Personal schulen (D), Betroffenenrechte gewährleisten (D) |

Genauigkeit & Sicherheit | Robustheit und Cybersicherheit gewährleisten (P), Pre-Deployment Testing (P) |

Konformität | Konformitätsbewertung durchführen (P), CE-Kennzeichnung anbringen (P), EU-Datenbank registrieren (P) |

Governance | Qualitätsmanagementsystem einführen (P), Verträge mit Drittanbietern regeln (P) |

Incident Response | Vorfallmanagement-Plan entwickeln (P+D), Korrekturmaßnahmen etablieren (P) |

Kurzversion: Was gilt für wen?

Risikostufe | Provider | Deployer |

Verboten | ❌ Nicht erlaubt | ❌ Nicht erlaubt |

Hochrisiko | Volle Pflichten (Risikomanagement, Konformität, Dokumentation, etc.) | Nutzungspflichten (Instructions befolgen, Logs führen, Mitarbeiter informieren) |

Transparenz | Technische Implementierung der Hinweise | Hinweise an Nutzer/Betroffene geben |

Minimal | Freiwillige Standards | Freiwillige Standards |

Wo starten? 3 praktische Quick-Wins

Ihr habt das Framework verstanden — aber wo konkret anfangen? Hier drei Empfehlungen:

Quick-Win 1: Der 60-Sekunden-Scope-Check

Bevor ihr euch in Details verliert: Prüft in einer Minute, ob euer System überhaupt in eine regulierte Kategorie fällt.

Fragen:

Interagiert das System direkt mit Personen?

Generiert es synthetische Inhalte?

Wird es in einem der Hochrisiko-Bereiche eingesetzt (Recruiting, Bildung, Finanzen, etc.)?

Könnte es manipulativ wirken oder Vulnerabilitäten ausnutzen?

Wenn alle Antworten "Nein" sind, habt ihr wahrscheinlich ein Minimal-Risiko-System.

Quick-Win 2: Rolle dokumentieren

Schreibt in einem Satz auf, welche Rolle ihr habt:

"Wir sind Provider/Deployer/beides, weil wir entwickeln/nutzen/beides und das System unter eigenem Namen/Verantwortung auf den Markt bringen/einsetzen."

Diese Klarheit hilft bei allen weiteren Schritten.

Quick-Win 3: Transparenzpflichten zuerst

Unabhängig von der Risikoeinstufung: Die Transparenzpflichten nach Artikel 50 gelten für viele Systeme und haben eine klare Deadline (2. August 2026).

Startet hier:

Chatbot? → Disclaimer implementieren

KI-generierte Inhalte? → Marking-Lösung evaluieren

Emotionserkennung? → Informationspflicht prüfen

→ Mehr dazu in unserem Praxis-Artikel: "Artikel 50 in der Praxis: Transparenzpflichten für Chatbots und Voicebots umsetzen"

Alle 3 Quick-Wins in Sekunden klären?

Mit dem TrustTroiAI Adventure Plan beschreibt ihr euer KI-Projekt in 2-3 Sätzen — und unser System führt euch durch genau diese drei Fragen: Scope, Rolle, Pflichten. Kein Recherchieren, kein Rätselraten.Wie TrustTroiAI diese Schritte vereinfacht

Das Framework ist klar — aber die Umsetzung erfordert Zeit, Expertise und Sicherheit. Genau hier setzt TrustTroiAI an.

Unser Ansatz: KI analysiert, Menschen entscheiden, Experten validieren

TrustTroiAI führt euch durch alle vier Schritte des Frameworks — automatisiert, aber mit menschlicher Kontrolle über jede Entscheidung. Und wenn ihr Sicherheit braucht: Unsere Experten-Validierung gibt euch die Gewissheit, dass eure Einschätzung stimmt.

Schritt 1 → Scope Check (Troi):

Beschreibt euer KI-Projekt in 2-3 Sätzen. Unser System prüft automatisch, ob und wie die KI-VO gilt.

Schritt 2 → Risiko-Klassifizierung:

Basierend auf eurem Use Case ermitteln wir die Risikostufe — mit Erklärung, warum.

Schritt 3 → Rollen-Ermittlung:

Wer seid ihr im Sinne der Verordnung? Provider, Deployer, oder beides?

Schritt 4 → Pflichten-Checkliste:

Konkrete, priorisierte Liste der Anforderungen für eure Situation — keine 180-seitige Verordnung, sondern das, was für euch relevant ist.

Finn: Euer Wissens- und Situationsassistent

Habt ihr unterwegs Fragen? Finn ist immer dabei:

Wissensassistent: Stellt Fragen zur KI-Verordnung, DSGVO oder NIS2 — Finn antwortet verständlich und zitiert die relevanten Artikel.

Situationsassistent: Finn kennt euren konkreten Case und kann situationsbezogene Antworten geben: "Gilt das auch für mein Recruiting-Tool?" → Finn weiß, was ihr gebaut habt.

Bruno: Experten-Validierung für Haftungssicherheit

Die Haftungsfrage: KI-gestützte Analysen sind hilfreich — aber wer haftet, wenn die Einschätzung falsch ist? Mit der Experten-Validierung durch Bruno bekommt ihr rechtliche Sicherheit von qualifizierten Compliance-Experten.So funktioniert es:

1. Ihr durchlauft das Assessment mit TrustTroiAI

2. Bei Unsicherheit oder komplexen Fällen: Klick auf "Experten-Validierung"

3. Ein Compliance-Experte prüft eure Einschätzung und gibt schriftliches Feedback

4. Ihr habt dokumentierte Sicherheit für eure Entscheidungen

Für wen ist das relevant?

Hochrisiko-Systeme, bei denen viel auf dem Spiel steht

Grenzfälle, bei denen die Einordnung nicht eindeutig ist

Unternehmen, die gegenüber Investoren oder Aufsichtsbehörden Compliance nachweisen müssen

Bonus → Templates & Vorlagen:

Für Transparenzhinweise, Dokumentation und mehr — Copy-Paste-fertig für euren Tech-Stack.

Fazit: Ein Framework, nicht ein Labyrinth

Die KI-Verordnung ist umfangreich — aber sie folgt einer klaren Logik:

1. Anwendungsbereich: Gilt die Verordnung für mich?

2. Risiko: Welche Stufe hat mein System?

3. Rolle: Bin ich Provider, Deployer, oder beides?

4. Pflichten: Was muss ich konkret tun?

Mit diesem Framework navigiert ihr durch die Regulierung, ohne euch zu verlieren. Und ihr müsst es nicht alleine tun.

Jetzt starten: Prüft in 60 Sekunden, ob und wie die KI-Verordnung für euer Projekt gilt — kostenlos und ohne Registrierung.

→ trusttroiai.com/scope-checkMehr über das TrustTroiAI-Universum: Lernt Troi, Finn, Bruno und die anderen Figuren kennen, die euch durch die KI-Compliance begleiten.

QUELLENVERZEICHNIS

[1] Verordnung (EU) 2024/1689 — Verordnung über künstliche Intelligenz (AI Act)

Artikel 2 (Anwendungsbereich), Artikel 5 (Verbotene Praktiken),

Artikel 6 (Hochrisiko-Klassifizierung), Artikel 50 (Transparenzpflichten)

[2] Knowledge Centre Data & Society / AI Flanders

"The Impact of the EU AI Act in 6 Steps" — Practical Implementation Tool

[3] EU AI Office Guidelines

Guidelines on the Definition of an AI System (Article 3)

Guidelines on Prohibited AI Practices (Article 5)

Kommentare