Le Cadre de la Loi IA de l'UE : Clarté en 4 Étapes

- cici BEL

- 9 avr.

- 10 min de lecture

180 pages. 113 articles. Des dizaines de définitions.

Quand vous ouvrez pour la première fois le Règlement de l'UE sur l'intelligence artificielle — la Loi IA en résumé — vous faites face à un défi : Par où commencer ? Qu'est-ce qui est pertinent pour mon projet ? Et qu'est-ce que je dois exactement faire ?

La bonne nouvelle : Vous n'avez pas besoin de tout lire. La Loi IA suit une logique claire — un cadre que vous pouvez suivre en quatre étapes. Dans cet article, nous vous montrons ce cadre, expliquons chaque niveau et vous donnons des conseils pratiques pour bien démarrer.

L'approche « inverse » : D'abord le risque, puis la définition

Avant de plonger dans le cadre, un conseil important de la pratique :

Le point de départ intelligent : Vérifiez d'abord si votre système relève de l'une des catégories de risque. Ce n'est que si la réponse est « oui » ou « peut-être » qu'il vaut la peine d'analyser la définition exacte de « système d'IA ».Pourquoi ? La définition d'un système d'IA dans la Loi IA n'est pas complètement claire et nécessite un effort considérable. Vous pouvez éviter cet effort si votre système ne relève de toute façon d'aucune des catégories réglementées.

Cette approche provient d'une analyse du Knowledge Centre Data & Society et présente un avantage pratique : elle vous fait gagner du temps et concentre votre énergie sur l'essentiel.

Le Cadre : 4 Étapes vers la Clarté

Étape | Question | Résultat |

1 | La Loi IA s'applique-t-elle vraiment ? | Clarifier le domaine d'application |

2 | Dans quelle catégorie de risque mon système relève-t-il ? | Déterminer le niveau de risque |

3 | Quel rôle je joue ? | Fournisseur, Utilisateur, etc. |

4 | Quelles obligations m'incombent ? | Exigences concrètes |

Passons en revue chaque étape.

Étape 1 : La Loi IA s'applique-t-elle vraiment ?

Tous les systèmes d'IA ne relèvent pas de la réglementation. Il y a des exemptions explicites :

Exemptions du Domaine d'Application

Recherche et Développement :

Les systèmes d'IA développés et utilisés exclusivement à des fins de recherche scientifique et de développement sont exemptés (art. 2 par. 6). Mais attention : dès qu'un système est commercialisé ou utilisé au-delà de la recherche, toutes les règles s'appliquent.

Utilisation privée et non-professionnelle :

La Loi IA ne s'applique pas si les personnes physiques utilisent un système uniquement à titre privé et non-professionnel.

Sécurité nationale et militaire :

Les systèmes destinés à la défense, à des fins militaires ou à la sécurité nationale sont exemptés.

Organisations internationales :

Les systèmes d'IA utilisés par des organisations internationales ou des pays tiers pour la coopération en matière d'application de la loi avec l'UE, sous certaines conditions.

Conseil pratique : « Nous sommes encore en développement » n'est pas une excuse permanente. En pratique, il est judicieux de tenir compte des exigences dès la phase de développement — même si elles ne s'appliquent pas officiellement encoreÉtape 2 : Classification des Risques

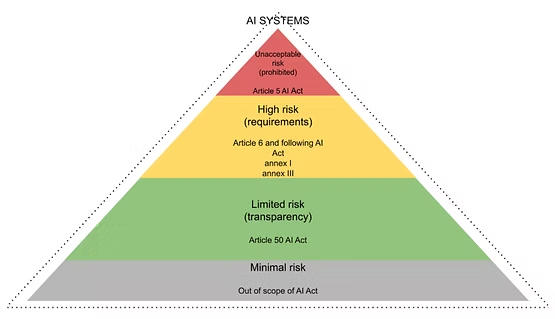

Le cœur de la Loi IA est l'approche basée sur le risque. Plus le risque est élevé, plus les exigences sont strictes. Il y a quatre niveaux :

Niveau 1 : Pratiques Interdites (art. 5)

Ces systèmes ne peuvent pas être mis sur le marché, mis en service ou utilisés dans l'UE. Ils sont considérés comme incompatibles avec les valeurs fondamentales de l'Europe.

Qu'est-ce qui est interdit ?

Systèmes manipulateurs :Techniques subliminales ou méthodes intentionnellement manipulatrices/trompeuses qui influencent substantiellement le comportement d'une personne et peuvent causer un dommage significatif.

Exploitation de vulnérabilités : Systèmes qui exploitent les faiblesses dues à l'âge, au handicap ou à la situation socio-économique.

Notation sociale : Évaluation ou classification de personnes basée sur le comportement social ou les caractéristiques personnelles qui mènent à une discrimination injustifiée.

Identification biométrique en temps réel : Dans les espaces accessibles au public à des fins de maintien de l'ordre (avec des exceptions étroites).

Reconnaissance d'émotions sur le lieu de travail/dans les établissements d'enseignement : Basée sur des données biométriques (exception : fins médicales ou de sécurité).

Bases de données de reconnaissance faciale : Constituées par extraction indiscriminée d'images d'Internet ou de vidéosurveillance.

Prédiction du risque criminel : Basé.

Niveau 2 : Systèmes à Haut Risque (art. 6)

Ces systèmes peuvent poser des risques graves pour la santé, la sécurité ou les droits fondamentaux. Ils sont autorisés, mais strictement réglementés.

Il y a deux types de systèmes à haut risque :

Type 1 — Sécurité des Produits :

Les systèmes d'IA qui font partie d'un produit (ou d'une composante de sécurité de celui-ci) qui relève de la législation sur les produits de l'UE existante ET qui nécessite une évaluation de la conformité par un tiers.

Exemples : Dispositifs médicaux, machines, jouets, ascenseurs, équipements sous pression, équipements radioélectriques.

Type 2 — Cas d'Usage Spécifiques :

Les systèmes d'IA destinés à des fins spécifiques dans des contextes spécifiques :

Domaine | Exemples |

Biométrie | Identification à distance, reconnaissance d'émotions, catégorisation biométrique |

Infrastructure Critique | Contrôle du trafic, approvisionnement en eau/gaz/électricité |

Éducation | Accès aux institutions, évaluation des performances d'apprentissage, surveillance d'examens |

Emploi | Recrutement, promotion, licenciement, allocation de tâches, surveillance de performance |

Services Publics | Prestations sociales, solvabilité, appels d'urgence, évaluation des risques d'assurance |

Exception importante : Les systèmes de type 2 ne sont pas à haut risque s'ils ne posent aucun risque substantiel pour la santé, la sécurité ou les

droits fondamentaux. C'est le cas si le système :

1. Effectue une tâche procédurale étroite

2. Améliore le résultat d'une activité humaine préalablement terminée

3. Détecte des modèles de décision sans remplacer l'évaluation humaine

4. Effectue une tâche préparatoire pour une évaluation

Cette exception ne s'applique pas si le système effectue du profilage.Niveau 3 : Obligations de Transparence (art. 50)

Indépendamment de la classification des risques, certains systèmes sont soumis à des exigences de transparence supplémentaires :

Si... | Alors... |

L'IA interagit directement avec des personnes (chatbot) | Informer les utilisateurs qu'ils interagissent avec l'IA |

L'IA génère du contenu synthétique (texte, image, audio, vidéo) | Marquage lisible par machine |

Reconnaissance d'émotions ou catégorisation biométrique | Informer les personnes concernées |

Deepfakes ou textes générés par l'IA sur des sujets publics | Obligation de divulgation |

→ Les détails sur l'article 50 se trouvent dans notre article : « Article 50 Loi IA : Obligations de Transparence Expliquées »

Niveau 4 : Risque Minimal

Tous les autres systèmes d'IA — la grande majorité — ne sont pas soumis à des exigences spécifiques. L'utilisation est libre, mais les codes de conduite volontaires sont recommandés.

Étape 3 : Quel Rôle Jouez-Vous ?

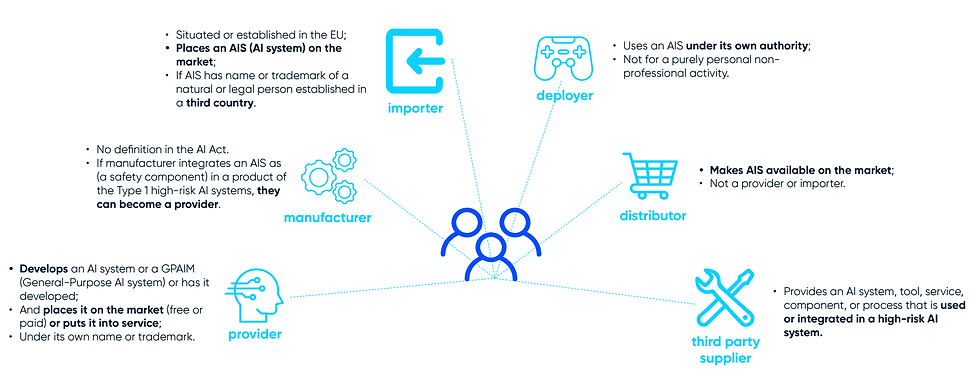

La Loi IA définit six rôles. Pas tous ne s'appliquent à votre projet — et une entreprise peut prendre plusieurs rôles à la fois.

Les Six Rôles

1. Développeur :

Vous créez le système d'IA (le modèle, le code, l'architecture). Cela peut se faire en interne ou être externalisé, mais la responsabilité reste la vôtre.

Exemples : Entreprise avec une équipe ML, cabinet de conseil ML externe, contributeur open-source.

2. Fournisseur :

Vous mettez le système d'IA sur le marché ou le mettez en service au sein de l'UE. C'est le rôle principal qui déclenche les obligations de conformité.

Exemples : Société SaaS offrant un service d'IA, fabricant plaçant un produit compatible avec l'IA sur le marché.

3. Utilisateur :

Vous utilisez le système d'IA dans un contexte professionnel — vous êtes client, pas créateur ni fournisseur original. Vous avez aussi des obligations, notamment pour les systèmes à haut risque.

Exemples : Entreprise utilisant une IA de recrutement tiers, banque utilisant une IA d'évaluation de crédit.

4. Distributeur :

Vous distribuez le système d'IA (généralement des logiciels) sans apporter de modifications substantielles. Vos obligations sont limitées mais non nulles — notamment en matière de transparence et de documentation.

Exemple : Revendeur de logiciels proposant un système d'IA.

5. Importateur :

Vous importez un système d'IA depuis un pays tiers dans l'UE et le rendez disponible sous votre nom. Vous assumez les responsabilités du fournisseur.

Exemple : Entreprise important et réétiquetant un système d'IA des États-Unis.

6. Représentant Autorisé :

Vous êtes nommé pour agir au nom d'un fournisseur (généralement de l'extérieur de l'UE). Vous le représentez légalement au sein de l'UE.

Exemple : Entité juridique basée dans l'UE représentant une société d'IA américaine.

Arbre de Décision : Quel Rôle Jouez-Vous ?

[INFOGRAPHIE-PLACEHOLDER : Organigramme « Quel Rôle Je Joue ? » — Organigramme Oui/Non]

Chemin de décision rapide :

Avez-vous créé le système d'IA ? → Développeur

Le mettez-vous sur le marché ou le mettez-vous en service dans l'UE ? → Fournisseur

Utilisez-vous un système d'IA tiers dans votre activité ? → Utilisateur

Le distribuez-vous sans modifications ? →Distributeur

L'importez-vous de l'extérieur de l'UE ? → Importateur

Agissez-vous pour un fournisseur de l'extérieur de l'UE ? → Représentant Autorisé

Étape 4 : Quelles Sont Vos Obligations dans le cadre Loi IA

C'est ici que la caoutchouc touche la route. Les obligations varient selon le rôle et le niveau de risque.

Aperçu des Obligations pour les Systèmes à Haut Risque

Pour les Fournisseurs :

Obligation | Ce que cela signifie | Délai |

Système de Gestion des Risques | Identification et atténuation permanentes des risques | Continu |

Documentation Technique | Enregistrements détaillés de la façon dont le système a été développé | Avant la mise sur le marché |

Gestion de la Qualité | Procédures pour les données d'entraînement et la surveillance des performances | Avant le marché |

Gouvernance des Données | Documentation des données utilisées pour l'entraînement et les tests | Avant le marché |

Tests et Validation | Tests indépendants par rapport aux spécifications de performance | Avant le marché |

Surveillance et Signalement d'Incidents | Signalement des incidents graves aux autorités de l'UE | Continu |

Transparence et Information | Fournir des informations claires aux utilisateurs et aux utilisateurs finaux | Continu |

Supervision Humaine | Conception pour un contrôle humain significatif | Avant le marché |

Pour les Utilisateurs :

Obligation | Ce que cela signifie |

Déploiement Éclairé | Comprendre les capacités et limites du système d'IA |

Évaluation des Risques | Évaluer si l'utilisation du système crée de nouveaux risques dans votre contexte |

Surveillance | Surveiller les performances et les résultats du système dans votre cas d'usage |

Documentation | Documenter votre évaluation des risques et vos décisions de déploiement |

Information des Utilisateurs | Informer les personnes affectées par les décisions de l'IA |

Signalement d'Incidents | Signaler les incidents graves au fournisseur |

Pour les Distributeurs et Importateurs :

Les obligations sont moins étendues mais incluent :

Maintenir la documentation

Assurer que le système est complet et intact

Signaler les incidents graves

Refuser de mettre des systèmes sur le marché si vous soupçonnez une non-conformité

Les Trois Quick-Wins : Par Où la Plupart des Entreprises Commencent

Vous n'avez pas besoin de tout résoudre en une fois. Nous avons constaté que la plupart des entreprises bénéficient de s'attaquer d'abord à trois points spécifiques. Utilisez-les comme points de départ.

Quick-Win 1 : Déterminer Votre Domaine d'Application

La question : La Loi IA s'applique-t-elle à mon projet ?

Pourquoi c'est important : Si la réponse est « non » ou « clairement exempt », vous economisez énormément de temps.

Par où commencer :

Votre système est-il déployé dans l'UE ? → Oui = probablement dans le champ d'application

Des personnes physiques sont-elles affectées ? → Oui = probablement dans le champ d'application

Est-ce purement de la recherche ? → L'exemption de recherche pourrait s'appliquer

Est-ce exclusivement un usage privé ? → L'exemption privée pourrait s'appliquer

Cette clarté aide avec toutes les prochaines étapes.

Quick-Win 2 : Identifiez Votre Rôle

La question :Suis-je un Fournisseur, un Utilisateur, ou les deux ?

Pourquoi c'est important : Votre rôle détermine les obligations qui vous incombent. Un utilisateur utilisant un système tiers a des obligations différentes d'un fournisseur.

Par où commencer :

L'avons-nous construit nous-mêmes ? → Fournisseur ou Développeur

L'achetons-nous auprès de quelqu'un d'autre ? → Utilisateur

La revendiquons-nous ? → Distributeur ou Importateur

Cette clarté aide avec toutes les prochaines étapes.

Quick-Win 3 : Vérifiez d'Abord les Obligations de Transparence

Indépendamment de la classification des risques : Les obligations de transparence en vertu de l'article 50 s'appliquent à de nombreux systèmes et ont un délai clair (2 août 2026).

Commencez ici :

Chatbot ? → Implémenter un avis de non-responsabilité

Contenu généré par l'IA ? → Évaluer la solution de marquage

Reconnaissance d'émotions ? → Vérifier l'obligation d'information

→ Plus de détails dans notre article pratique : « Article 50 en Pratique : Implémenter les Obligations de Transparence pour les Chatbots et les Voicebots »

Clarifier les 3 quick-wins en quelques secondes ?

Avec le Scope Check de TrustTroiAI, décrivez votre projet d'IA en 2-3 phrases — et notre système vous guide à travers exactement ces trois questions : Domaine d'application, Rôle, Obligations. Pas de recherche, pas de devinage.Comment TrustTroiAI Simplifie Ces Étapes

Le cadre est clair — mais la mise en œuvre nécessite du temps, de l'expertise et de la certitude. C'est exactement où TrustTroiAI intervient.

Notre Approche : L'IA Analyse, les Humains Décident, les Experts Valident

TrustTroiAI vous guide à travers les quatre étapes du cadre — automatisé, mais avec contrôle humain sur chaque décision. Et si vous avez besoin de certitude : notre validation par les experts vous donne confiance que votre évaluation est correcte.

Étape 1 → Scope Check (Troi) :

Décrivez votre projet d'IA en 2-3 phrases. Notre système vérifie automatiquement si et comment la Loi IA s'applique.

Étape 2 → Classification des Risques :

Basé sur votre cas d'usage, nous déterminons le niveau de risque — avec explication du pourquoi.

Étape 3 → Identification du Rôle :

Qui êtes-vous selon le règlement ? Fournisseur, Utilisateur, ou les deux ?

Étape 4 → Liste de Contrôle des Obligations :

Liste concrète et priorisée des exigences pour votre situation — pas un règlement de 180 pages, mais ce qui est pertinent pour vous.

Finn : Votre Assistant de Connaissances et de Contexte

Avez-vous des questions en chemin ? Finn est toujours là :

Assistant de Connaissances : Posez des questions sur la Loi IA, le RGPD ou la NIS2 — Finn répond clairement et cite les articles pertinents.

Assistant de Contexte : Finn connaît votre cas spécifique et peut donner des réponses situées : « Cela s'applique-t-il aussi à mon outil de recrutement ? » → Finn sait ce que vous avez construit.

Bruno : Validation d'Experts pour la Sécurité en Matière de Responsabilité

La question de responsabilité : L'analyse assistée par l'IA est utile — mais qui est responsable si l'évaluation est incorrecte ? Avec la validation d'experts par Bruno, vous obtenez la certitude juridique d'experts en conformité qualifiés.Voici comment cela fonctionne :

1. Vous complétez l'évaluation avec TrustTroiAI

2. En cas d'incertitude ou de cas complexes : Cliquez sur « Validation d'Experts »

3. Un expert en conformité examen votre évaluation et fournit un retour écrit

4. Vous avez une sécurité documentée pour vos décisions

Pour qui est-ce pertinent ?

• Systèmes à haut risque où beaucoup est en jeu

• Cas limites où la classification n'est pas claire

• Entreprises devant prouver la conformité aux investisseurs ou aux autorités de régulation

Bonus → Modèles et Listes de Contrôle :

Pour les avis de transparence, la documentation, et plus — prêts à copier-coller pour votre pile technologique.

Conclusion : Un Cadre, Pas un Labyrinthe

La Loi IA est extensive — mais elle suit une logique claire :

1. Domaine d'Application : La réglementation m'en applique-t-elle ?

2. Risque : Quel niveau a mon système ?

3.Rôle : Suis-je Fournisseur, Utilisateur, ou les deux ?

4. Obligations :Qu'est-ce que je dois exactement faire ?

Avec ce cadre, vous naviguez dans la réglementation sans vous perdre. Et vous n'avez pas à le faire seul.

Commencez maintenant :

Vérifiez en 60 secondes si et comment la Loi IA s'applique à votre projet — gratuit et sans inscription.

→ trusttroiai.com/scope-checkEn savoir plus sur l'univers TrustTroiAI :

Rencontrez Troi, Finn, Bruno et les autres personnages qui vous guident à travers la conformité IA.

SOURCES

[1] Règlement (UE) 2024/1689 — Règlement sur l'intelligence artificielle (Loi IA)

Article 2 (Domaine d'Application), Article 5 (Pratiques Interdites),

Article 6 (Classification des Haut Risque), Article 50 (Obligations de Transparence)

[2] Knowledge Centre Data & Society / AI Flanders

« The Impact of the EU AI Act in 6 Steps » — Outil d'Implémentation Pratique

[3] Directives du Bureau IA de l'UE

Lignes Directrices sur la Définition d'un Système d'IA (Article 3)

Lignes Directrices sur les Pratiques d'IA Interdites (Article 5)

Commentaires